|

"Vocabulaire des Nouvelles Technologies Musicales" Editions Minerve (1994) - Mise à jour (2013) |

||||||||||||||||

|

P |

||||||||||||||||

|

Qui révèle les contradictions entre la perception et la description physique du son. * Paradoxe de durée Battements rythmés dont la cadence semble ralentir quand on double la vitesse du magnétophone sur lequel on les joue (Risset, 1986). * Paradoxe de hauteur Sons dont la hauteur semble descendre quand on double les fréquences qui le compose (Risset, 1971). Dans sa pièce Computer Suite from Little Boy (1968), J.-C. Risset utilise des glissandis qui descendent sans fin. Jean Claude Risset, "Hauteur et timbre des sons", 1978 "Pour des sons formés d'octave, la hauteur tonale varie avec la fréquence fondamentale alors que la hauteur spectrale varie avec l'enveloppe spectrale".

Ce sont les caractéristiques physiques des équipements électroniques qui reçoivent, traitent, modifient et transmettent les signaux sonores. Dans les musiques amplifiées, électroacoustiques et électroniques, les multiples chaînons qui conduisent le signal du studio à l'auditeur, imposent à chaque étape des contraintes : la tolérance globale admissible est souvent inférieure à la somme des tolérances partielles. * Bandes latérales (side-band) En transmission, le produit de deux signaux fait apparaître dans le spectre, des fréquences étrangères qui sont la somme et la différence des fréquences d'origine: elles forment des bandes latérales. * Bande passante Contenu fréquentiel restitué par un appareil audio (haut-parleur, microphone, tuner, etc.), la bande passante est limitée par une fréquence grave (Fmin) et une fréquence aigüe (Fmax). Pour tout matériel, elle doit être au moins égale ou supérieure à celle de l'oreille (20 Hz à 20 kHz) pour ne pas perdre des fréquences: au-dessous de 20 Hz, les "infra-sons" ne procurent pas de sensation auditive; autour de 20 Hz apparaît la sensation de hauteur qui diffère d'un individu à l'autre; au-dessus de 20 kHz, les "ultra-sons" ne produisent plus de sensation auditive mais peuvent être des composantes harmoniques. La sensibilité de l'oreille n'est pas égale dans toute sa bande passante: la zone moyenne qui couvre le domaine de la parole (de 500 à 4 kHz) est plus sélective dans le domaine fréquentiel. * Courbe de réponse La courbe de réponse amplitude/fréquence traduit la sensibilité de l'appareil audio aux diverses fréquences de sa bande passante. Si la réponse était parfaite, on devrait obtenir une tension identique pour chaque fréquence, donc une ligne horizontale : pratiquement, la courbe de réponse présente toujours des irrégularités plus ou moins importantes. * Diaphonie (Crosstalk), Paradiaphonie et Télédiaphonie C'est la perturbation qui se crée entre les lignes électriques d'un même câble. On peut mesurer l'isolation entre les canaux gauche et droit d'un système stéréophonique, et réduire la diaphonie par des algorithmes DSM (Dynamic Spectrum Management). Sur un magnétophone, la diaphonie est le résultat d'un mauvais contact entre les têtes et les pistes de la bande magnétique: ce qui se traduit par une augmentation du niveau des fréquences basses. En paradiaphonie (Near End Cross Talk), la perturbation émise par une paire est reçue par les récepteurs des paires voisines du même côté du câble (colocalisation). En télédiaphonie (Far End Cross Talk), la perturbation causée par une paire est reçue par les récepteurs des paires voisines, mais à l'autre extrémité du câble. * Distorsion On appelle distorsion (harmonique, d'intermodulation, de phase) toute déformation du signal, liée à la non-linéarité d'un appareil audio. Le taux de distorsion harmonique se mesure en faisant le rapport entre les valeurs efficaces du signal parasite et du signal total. Pour un signal, formé d'un fondamental d'amplitude a(1) et d'harmoniques d'amplitude respective a(n), le taux de distorsion partielle pour l'harmonique n est égale à D(en %) = 100 x a(n) / a(1). La distorsion d'intermodulation transitoire est une déformation importante du signal, liée essentiellement à la vitesse de réaction des circuits électroniques. Une chaîne audiofréquence analogique présente toujours une distorsion de phase entrée/sortie plus ou moins importante: elle ne doit pas présenter de distorsion de phase entre voies. Jean-Baptiste Fourier, "Théorie de l'analyse harmonique "Une distorsion intervient au moment où le son est produit, car l'objet qui en est la source doit, avant de se mettre en mouvement, vaincre sa propre inertie". * Drop Chute rapide et brève du niveau du signal enregistré : des variations de faible amplitude et de courte durée peuvent se traduire par un phénomène de légers craquements perceptibles surtout sur les sons tenus. Les drops sont souvent le fait de défauts de structure de la bande (hétérogénéité de la couche magnétique, aspérités de surface ou poussières). * Dynamique C'est l'écart (en dB) entre le niveau maximal et le niveau minimal d'une modulation. Forte, elle ne doit pas atteindre le niveau maximum et faible, elle doit se situer au moins 20 dB au-dessus du bruit de fond pour le confort d'écoute. Cette définition, qui résulte des impératifs de la transmission et de la réception, atteste la valeur subjective de la dynamique. Elle est nécessairement plus faible que le rapport signal /bruit. Il existe deux types d'appareils de traitement de la dynamique: les amplificateurs à gain fixe et les compresseurs/extenseurs à gain variable. * Intermodulation Lorsque l'on injecte deux signaux simultanément dans un canal de transmission, on trouve en sortie une combinaison linéaire, un produit et une intermodulation de fréquences de ces signaux (f1-f2; f1+f2). L'intermodulation est une modulation en anneau. * Pleurage (wow ou drift) Fluctuation de tonalité provoquée par les variations de vitesse du défilement de la bande magnétique. Ces variations lentes sont inférieures à 10 Hz. On distingue : ■ la dérive (drift) : variations inférieures à 0,5 Hz ; ■ le pleurage (wow) : variations entre 0,5 Hz et 10 Hz. * Ronflette C'est la présence d'une fréquence grave ({ à 50 Hz), qui signe une mauvaise mise à la masse de l'un des appareils du studio. Une liaison symétrique/asymétrique non conforme, une masse et un conducteur qui se touchent à l'arrière d'un patch, sont souvent à l'origine de ces bruits parasites. * Scintillement (Flicker, Flutter ou Scrape Flutter) On distingue deux types de scintillement : ■ le bruit de scintillation dans les circuits intégrés : il est perçu comme une suite de "plops" ; ■ la fluctuation de tonalité provoquée par les variations de vitesse du défilement de la bande magnétique : de 10 à 50 Hz, ce sont des "chevrotements" (flutter) et au-delà de 50 Hz, des "bruit de modulation" (scrape flutter). * Signal sur bruit C'est le rapport entre le niveau maximum de sortie et le niveau de bruit de fond de tout système électronique (actif ou passif). Exprimée en dB, la valeur du rapport signal sur bruit est de ce fait inférieure au niveau de référence du 0 dB électrique. Elle donne une indication précieuse quant aux performances de chaque système: 60 dB pour l'enregistrement magnétique; 90 dB pour l'enregistrement numérique. Dans ce cas, le nombre n de bits alloués à chaque échantillon détermine la valeur du rapport signal/bruit: 20 Log(2n).

Ce sont les dimensions de l'écriture qui définissent le système opératoire du compositeur. Aux paramètres traditionnels de la musique classique (hauteur, durée, intensité, timbre, tempo), la musique contemporaine a progressivement ajouté le degré d'ordre, la densité, la localisation spatiale, le mode d'attaque et la structure microscopique du son. En 1959, G. Scelsi écrit quatre pièces sur une seule note (Quatro Pezzi pour orchestre de chambre) qui explorent ces paramètres. Aujourd'hui encore, il est difficile d'intégrer dans l'écriture, la microstructure physique, l'incidence perceptive des vibrations acoustiques et les différents contrôles en temps-réel. Il faudra certainement enrichir la partition numérique pour lui donner son rôle de représentation des musiques amplifiées, électro-acoustiques et électroniques. * Degré d'ordre Dans beaucoup de musiques écrites aujourd'hui, on retrouve des éléments précis (au sens de la partition classique) et des éléments aléatoires (paramètres non précisés) : cf. Cris de M. Ohana. Ce concept d'ordre appliqué aux paramètres musicaux est né dans les années 1950, lorsque L. Hiller et L. Issacson, les pionniers de l'informatique musical, ont utilisé des chaînes de Markov pour introduire différentes structures périodiques dans l'organisation temporelle de l'oeuvre. * Densité Nombre d'évènements contenus dans un nuage sonore ou dans un accord. On peut alors faire varier soit la capacité de jeu des instrumentistes (entre 0,11 et 150 sons par seconde pour un grand orchestre), soit le nombre de raie spectrale (entre une et l'infini pour le bruit). I. Xénakis est ainsi le premier à employer la densité comme paramètre musical : ce qui permet la réalisation de masse sonore variable (Métastasis, 1954). K. Saariaho, quant à elle, fait évoluer un accord par des facteurs de contraction/expansion (Jardin secret I et II, 84-86). * Durée Dans la musique classique, la durée d'un mouvement est régie par le nombre de ses mesures : cette mesure comprend une unité de temps (double croche, croche, noire, blanche ou autre) qui définit en général la durée relative de base des événements sonores qui apparaissent dans le mouvement donné (adagio, scherzo, allegro, etc.). Igor Stravinsky, "Poétique musical", 1952 "Le mètre résout la question de savoir en combien de parties égales se divise l'unité musicale que nous nommons la mesure, et le rythme résout la question de savoir comment seront groupées ces parties égales dans une mesure donnée". L'introduction des valeurs temporelles microscopiques comme la durée des transitoires de l'"objet sonore", le temps d'arrivée des ondes et le temps de réverbération introduise de nouvelles possibilités de jeux dans l'écriture. I. Prigogine, I. Stengers : "Entre le temps et l'éternité" (1988) "La question du temps, un et multiple, articule notre besoin de construire une conception plus unifiée du monde avec la multiplicité des regards que ce monde exige de nous". "La flèche du temps s'inscrit à tous les niveaux, du plus simple des objets quantiques à l'Univers lui-même, né d'une formidable explosion entropique". Parmi ces possibilités, on peut citer : ■ le champ temporel : K. Stockhausen définit ce champ comme une durée dans laquelle s'inscrit le jeu de l'instrumentiste ; ■ le pivot temporel : point de rencontre qui structure l'oeuvre (M. Stroppa: "Une représentation de structures temporelles par synchronisation de pivots", 1990) ; ■ le temps directionnel qui donne la primauté au lieu d'émission du son par rapport à l'auditeur, plutôt qu'au temps directionnel qui traite un passé et un futur ; ■ le temps "strié" et le temps "lisse" : concept créé par P. Boulez, pour établir une distinction entre les structures de durée qui se réfèrent au temps chronométrique et celles qui n'ont plus de référence. Gérard Grisey, Entretemps, n°8, 1989 "Un son isolé cela n'existe pas ; on l'écoute en fonction de ce qui précède et on en garde un souvenir plus ou moins long, vague ou précis. Le temps musical est un temps élastique dont la notion varie au fil des évènements qui le jalonnent". * Hauteur Au sens classique du terme, c'est une hauteur tonale attribuée à un son sur l'échelle des 12 sons de la gamme chromatique : du Do1 à Do9. Par analyse, on sait qu'en dessous de 500 Hz, environ 140 degrés sont différentiables : les échelons sont égaux. Entre 500 Hz et 16 kHz, 480 degrés sont discernables : les échelons augmentent proportionnellement à la fréquence mais les intervalles harmoniques deviennent de plus en plus petit. Seuls les intervalles de l'échelle de hauteur mélodique sont perçus comme étant égaux, quelle que soit leur hauteur. La hauteur tonale et la hauteur spectrale sont bien distinctes : l'une provient de la fréquence du fondamental, l'autre de la distribution spectrale. Déjà A. Schönberg ne pouvait guère admettre qu'il y ait une telle différence entre le timbre et la hauteur. Arnold Schönberg dans Risset, "Paradoxes de hauteur", 1978 "Selon moi, le son est perceptible par son timbre, et l'une de ses dimensions est la hauteur. La hauteur n'est pas autre chose que le timbre mesuré dans une direction". Depuis, on a observé qu'à partir des indices sensoriels, l'oreille distingue bien entre la hauteur tonale comme variation de la fréquence du fondamental, et la hauteur spectrale comme variation de l'enveloppe spectrale (Risset, 1978). Cette dissociation peut conduire à des variations de hauteur paradoxales : sons donnant l'illusion de monter ou de descendre sans fin (R. N. Shepard : paradoxe de Penrose, 1964). Les algorithmes d'analyse psycho-acoustique (Terhardt, 1982), permettent de déterminer avec une certaine fiabilité, pour un son complexe d'origine quelconque (cloches, textures, sons de synthèse), la différence entre les hauteurs spectrales (fréquences des partiels déterminées par la transformée de Fourier) et les hauteurs tonales (hauteurs perçues). * Intensité Elle se situe entre ce qui est juste audible (le pianissimo) et ce qui devient un seuil de douleur (le fortissimo) suivant la dynamique propre de l'instrument (intensité relative avec les autres instruments, variation de la dynamique avec la fréquence) et la différence de perception auditive (propriété de l'oreille dans le grave, le médium ou l'aigu). Aujourd'hui, l'intensité peut être mis en relation avec la distance réel ou virtuel de la source sonore dans l'espace de représentation. Igor Stravinsky, "Poétique musical" (1952) "Les musiciens devraient se rendre compte, comme les techniciens de la publicité, qu'il en est de leur art comme de l'art de l'affiche : l'enflure du son ne retient pas l'oreille, de même que de trop grandes lettres n'attachent pas le regard". * Localisation spatiale Elle définie la place des source (instruments, voix ou haut-parleurs) sur la scène sonore. Historiquement, la disposition allemande ou "européenne" (graves au centre) et la disposition "américaine" ont fixés la forme de l'orchestre symphonique actuel. D'autres formes, comme celle du "Pierrot" (pour voix, flûte, clarinette, violon, violoncelle et piano) issue du Pierrot lunaire (1912) d'A. Schönberg sont des modèles d'équilibre intuitif entre les sources instrumentales. Depuis les années 1930, l'électrification instrumental a considérablement modifié les dispositifs acoustiques traditionnels. Dans les années 1960, la formule du trio (guitare, basse, batterie) popularisée par J. Hendrix est à la base du groupe rock. Si le choix et la place des instruments est le fait de décisions empiriques et culturelles, ce n'est que depuis peu qu'on a pris conscience de l'importance du rayonnement des sources dans l'air. L'étude de leur directionnalité permet ainsi de mieux cerner et justifier leur place (Meyer, 1970). L'analyse nous montre que l'image sonore varie énormément d'un point à l'autre de l'espace (Garcia, 1983) : ce qui permet de créer des dispositifs de diffusion inédits, basés sur les propriétés objectives du rayonnement acoustique. Peter Szendy, "Actes d'une dislocation", 1994 "Immobiliser les sons qui durent dans leur lieu, et s'attacher à leur parcours, voire à celui de l'auditeur: entre spatialisme et cinétisme, entre une pure occupation de l'espace et son mouvement, il y a place pour une interrogation sur l'acte d'écrire, sur les relations que cet acte instaure entre l'espacement propre à l'écriture et l'espace accueillant sa diffusion sonore". J. Blauert (1974) a ainsi remarqué qu'il y avait une relation claire entre la bande de fréquence et la direction de l'évènement sonore. Il distingue ainsi trois directions principales : derrière la tête (fréquence inférieure à 1 kHz), devant la tête (fréquence comprise entre 500 Hz et 1 kHz) et au-dessus de la tête (fréquence supérieure à 8 kHz). Eero Tarasti, "L'espace dans le discours musical", 1994 "Les chanteurs imaginent souvent leurs voix comme se mouvant dans l'espace: on ne chante pas des gammes du haut en bas et d'avant en arrière, on les chante du proche au lointain et du lointain au proche. L'art du chant - comme tous les performing arts - est un art de poser quelque chose devant les auditeurs". * Timbre Entité fonctionnelle qui concoure à l'identité d'une même classe de sons, le timbre naît de la sensation et de l'identification par le cerveau : l'analyse spectrale du stimulus sonore s'effectue sur une durée au moins égale à 50 ms. Cette identité est liée à des relations entre paramètres plutôt qu'à des valeurs caractéristiques qui changent lors de la propagation. L'auditeur n'entend pas le même spectre suivant qu'il est ou non dans l'axe de l'instrument mais il identifie la même source. Ce processus de compensation (ou réafférence vestibulaire) annule le déplacement apparent des sources quand le sujet se déplace. Il en est de même pour les voyelles allophones qui sont des variations expressives d'un même groupe mais qui sont extraites de mots ou de locuteurs différents. J. C. Risset, "Son musical et perception auditive", 1986 "La notion de timbre implique la fusion. Elle correspond à la qualité sonore d'un ensemble de composantes intégrées en une entité auditive et assignées à une même source sonore réelle ou virtuelle". En 1909, A. Schoenberg introduit dans sa troisième pièce pour orchestre op.16, la mélodie de timbre (Klangfarbenmelodie), succession de sons dont le rapport agit avec une logique en tout point équivalente à une mélodie. A la suite des données expérimentales, il semble que le timbre puisse faire l'objet d'une mise en échelle analogue à celle qui règle l'espace tempéré. Ce "solfège" des timbres, basé sur une relation de distance séparant deux timbres distincts, serait accessible à toutes les oreilles. Le modèle d'intervalle contiendrait en outre l'orientation ou le degré de changement sur chacune des dimensions de l'espace. A. Schoenberg, "Traité d'harmonie" (1911) "S'il est possible maintenant, à partir de timbres différenciés par la hauteur de faire naître des figures sonores que l'on nomme mélodie - succession de sons dont la cohérence même suscite l'effet d'une idée - alors il doit être également possible, à partir de pures couleurs sonores - les timbres - de produire ainsi des successions de sons dont le rapport entre eux agit avec une logique en tout point équivalente à celle qui suffit à notre plaisir dans une simple mélodie de hauteur". A la suite des travaux de J. M. Grey (Multidimensional perceptual scaling of musical timbre, 1977) et de D. Wessel (Timbre space as a musical control structure, 1979), on peut aujourd'hui attribuer à chaque timbre instrumental un poids spécifique, indicateur de ses caractéristiques perceptives. Dans Mirages (1978), J. C. Risset tire parti des parcours continus ou discontinus dans l'espace des timbres. * Vitesse d'exécution (tempo) Avant l'invention du métronome, le battement du coeur servait de référence au tempo. Depuis le XIXème s., le tempo, mesuré par le métronome de Maelzel, définit la vitesse d'exécution d'un mouvement. Or on sait depuis Galilée, qu'un mouvement est toujours relatif : tout dépend du référentiel par rapport auquel on se situe. Avec Einstein, le temps est lui aussi relatif et donc la simultanéité de deux faits sonores n'existent pas. Il est alors intéressant d'entendre les processus polyrythmiques du Moyen Age, les musiques contrapuntiques et les écritures polymétriques (Charles Ives : March 1776, 1904) qui ont mis en forme des mouvements différents. Dans Gruppen (1955-57) et Zeitmasse (1955-56), K. Stockhausen fonde l'articulation formelle sur un tempo individuel et collectif : au lieu d'accumuler des valeurs irrationnels, l'indication métronomique suffit à définir la relativité du temps musical. Récemment, M. Stroppa ("Une représentation de structures temporelles par synchronisation de pivots", 1990) introduit la notion de pivot temporel comme point de rencontre structurant l'oeuvre. C. Fatus, "Composition musicale et informatique" (1989) "Le jeu du compositeur sera d'assimiler les évènements sonores à des particules et de construire des modèles acoustiques avec le mouvement de ceux-ci dans des proportions à analyser".

Ce sont les attributs objectifs de la perception auditive. Ils interviennent dans l'acoustique des salles, les télécommunications audiovisuelles et la mise en oeuvre des réalités virtuelles. Olivier Warusfel, "Technologie et perception auditive", 1994 "La connaissance de la structuration perceptive relayée par une formulation mathématique offre une médiation entre l'écoute et la transcription, entre la lecture et la production sonore, et répond au soucis d'une meilleure conceptualisation des effets perçus". * Clairaudience Acuité auditive exceptionnelle, en particulier pour les sons de l'environnement. * Clarté Qualité des premières réflexions d'un signal reçu en un point d'écoute. La clarté se définit comme un rapport entre l'énergie contenue dans les premières 80 ms et l'énergie au-delà. * Cohérence Dans les conditions naturelles d'écoute, la cohérence spatiale de l'image auditive est déterminée par une relation entre la différence de temps et la différence d'intensité des ondes incidentes qui parviennent aux oreilles. Les études actuelles tentent d'appréhender ce qui fait la logique d'un timbre quelque soit l'orientation de sa perception (Risset, 1991). * Présence Qualité du timbre, liée à l'intensité des composantes situées autour de 2000 Hz (fréquence sensible de l'aire d'audition). * Sonie (Loudness) Caractère de la sensation auditive, la sonie est liée principalement à la pression acoustique et à ses variations: un son est fort ou faible selon la pression acoustique plus ou moins élevée. La sonie d'un son faible varie beaucoup avec la fréquence alors qu'elle varie peu pour un son fort. On ne peut pas juger un son à un niveau différent de son intensité naturelle. On attribue arbitrairement une sonie à un son de niveau acoustique égal à 40 dB, de fréquence 1 kHz et de durée 1 sec. * Tonie Elle dépend surtout de la fréquence du son perçu et localise la sensation de hauteur sur une échelle, l'échelle des mels. Cette sensation est aussi liée à celle de durée (la fréquence étant une fonction temporelle) et à celle d'intensité quand celle-ci croît. On attribue par exemple une tonie de 131 mels à un son pur de 131 Hz, de niveau acoustique constant égal à 80 dB et de durée fixe de 1 seconde. En dessous de 500 Hz, chaque octave comporte deux fois plus de degrés de tonie que le précédent. Au delà, n'importe quel octave comporte 100 degrés de tonie. On en déduit que pour les sons graves, la fréquence en Hz et la tonie sont identiques: ce qui n'est pas le cas dans l'aigu. Pour les sons intenses, la tonie peut varier jusqu'à +8% dans l'aigu et -8% dans le grave. Pour les sons brefs, la tonie décroît à cause du temps d'intégration de l'oreille. Pour tous les autres sons, la présence d'un formant dans un spectre peut faire apparaître des phénomènes paradoxaux.

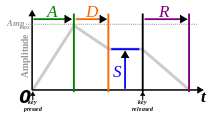

Ce sont les dimensions physiques du signal sonore, constamment employées en studio ou en sonorisation avec les paramètres audiofréquences des équipements. * Amplitude Valeur de l'intensité d'un signal sonore, l'amplitude se mesure en décibel (ou dB). On a observé (Blauert, 1974) qu'une atténuation de 6 dB correspondait au doublement de la distance de l'auditeur par rapport à la source. * Enveloppe d'amplitude Elle désigne l'évolution temporelle de l'amplitude d'un son. On distingue généralement quatre transitoires: l'attaque (attack), la chute (decay), l'entretien (sustain) et l'extinction (release). D'où la dénomination ADSR du générateur d'enveloppe (envelopp schaper) sur les premiers synthétiseurs anglo-saxons. Aujourd'hui, on a une construction par niveau et par pente.

L'enveloppe d'amplitude peut être convertie en tension par un suiveur d'enveloppe (envelopp follower) et être appliquée sur un autre signal (technique du vocodeur). La manipulation des enveloppes en synthèse additive peut donner lieu à d'intéressantes métamorphoses. * Enveloppe spectrale Courbe d'amplitude des diverses fréquences qui composent un signal sonore, elle délimite la bande de fréquence ou la répartition fréquentielle de l'énergie dans le spectre. * Formant Pic d'amplitude situé dans le spectre harmonique, le formant est souvent produit par la caisse de résonance de l'instrument : conduit vocal (gorge, bouche, sinus) pour la voix, caisse de résonance pour les instruments à cordes, ou forme du matériau pour les instruments à vents. Un formant est caractérisé par sa fréquence centrale (position dans le spectre), son amplitude (valeur du pic) et sa largeur de bande (étendue spectrale). Les sons vocaux font apparaître jusqu'à 5 formants : les 3 premiers servent l'intelligibilité alors que le 4ème et le 5ème servent à l'identification. * Fréquence (cf. - ) La fréquence fondamentale d'un signal se confond avec sa première harmonique : sa période est égale à celle du signal lui-même. * Harmonique Fréquence multiple de la fondamentale Fo : F(n) = n x Fo. La sensibilité aux harmoniques subjectives est due aux propriétés de l'oreille: apparition d'harmoniques, addition d'un son fondamental, son de combinaison. * Inharmonique Fréquence non multiple de la fréquence fondamentale. * Partiel Fréquence multiple ou non de la fréquence fondamentale. * Période Inversement proportionnelle à la fréquence Fo du signal, la période T est la dimension temporelle de la microstructure du son : T = 1 / Fo * Phase Valeur du décalage temporel d'un partiel par rapport à l'origine du fondamental. En stéréophonie, un décalage inférieur à 1 ms entre deux signaux, détermine la localisation angulaire de l'image auditive. Le déphasage de chaque partiel varie selon les positions relatives et les directions des composantes spatiales du champ acoustique. * Spectre Ensemble des partiels, contenus dans le son. Une onde sinusoïdale pure ne comporte qu'un partiel alors qu'un son musical en contient une multitude. L'observation du spectre montre une structure fine qui évolue rapidement en fonction de la fréquence (pics de partiels et bruit d'attaque : souffle) et une structure globale qui évolue lentement en fonction de la fréquence (enveloppe spectrale et formants). Si des composantes étrangères sont introduites, ces fréquences sont soit des harmoniques ou des translations des raies d'origine, soit des combinaisons (somme ou différence des fréquences). * Spectre de phase Ensemble des décalages temporels des différents partiels.

Paramètre de la salle d'écoute Ensemble des caractéristiques d'une salle dont les dimensions, la géométrie, le volume et la nature des parois concourent à la qualité de la propagation des ondes entre les zones d'émission (place des instruments) et les zones de réception (place des auditeurs). Guy Lelong, "Musique in situ", 1994 "Le lieu d'accueil d'une oeuvre peut être seulement considéré comme le cadre où elle est présentée, ou au contraire pensé comme une instance capable de générer l'oeuvre elle-même". * Bruit de fond (cf. -) * Densité spectrale Altération de "coloration" des signaux sonores aux divers points d'écoute, la densité spectrale définie l'isotropie de la salle, son confort d'écoute et son bruit de fond. Elle précise son adéquation à tel type de message. * Efficacité latérale Energie latérale par rapport à l'énergie totale, elle concerne surtout les premières réflexions. * Inertie Nombre de sons par seconde perceptibles sans altération des attaques, l'inertie traduit la mollesse ou la vivacité du lieu. * Premières réflexions (EDT) C'est la durée de réverbération sur les 10 premiers décibels de décroissance auxquels nous sommes très sensibles. On peut intervenir sur l'arrivée des premières réflexions en modifiant les emplacements ou la nature des surfaces génératrices: conque d'orchestre modulable, réflecteurs mobiles. * Pouvoir séparateur Capacité de l'audition à séparer les éléments d'un flux auditif (syllabe, note), le pouvoir séparateur objectivise la netteté et l'intelligibilité. On en déduit le pourcentage d'articulation. * Réverbération (cf. - ) * Temps de réverbération (cf. Réverbération) * Traînage "Echo" ou "halo", le traînage définit l'information esthétique du message.

* Pavillon de l'enceinte acoustique Système acoustique monté devant un haut-parleur, le pavillon favorise le transfert d'énergie de la membrane vers la salle. Le rapport de la transformation dépend du rapport entre la surface de gorge et la surface d'ouverture. La bande passante est ainsi conditionnée par la vitesse de transition entre ces deux surfaces. On peut actuellement contrôler de façon très efficace la directivité suivant la forme du plan d'onde. * Pavillon de l'oreille Il compose avec le conduit auditif, l'oreille externe. Le pavillon dirige les ondes sonores vers l'intérieur et amplifie la pression acoustique par résonance avec le conduit. Il en résulte un léger renforcement des fréquences entre 2 kHz et 5 kHz avec un maximum autour de 3700 Hz. Son rôle est non négligeable dans l'orientation spatiale. La modification des replis du pavillon transforme considérablement l'écoute (Wayne Batteau, 1967).

Elle est à l'origine une faculté instinctive de prévention contre les dangers naturels et joue souvent un rôle d'alerte plus efficace que la vue ou le toucher. La perception est un processus actif où l'interprétation mentale se construit à partir de ce qui est donné à entendre. A chaque instant, la vibration sonore va exciter la membrane de l'oreille externe, stimuler le nerf auditif de l'oreille interne et déterminer chez le sujet les sensations. L'oreille est capable de détecter en temps réel la différence microscopique des signaux, et peut, dans un environnement complexe, analyser et reconnaître leurs significations (effet Cocktail Party). Elle est surtout sensible au contenu spectral des sons et à l'évolution temporelle de ce contenu. A. Moles, "Théorie de l'information" (1972) "Percevoir, c'est sélectionner et apprendre le monde, c'est apprendre les règles de la sélection perceptive". Les grandes phases de traitement de l'information auditive se retrouvent dans la liste suivante (S. McAdams, E. Bigand : Penser les sons, 1994) : ■ la transduction (réception et transformation de la variation de pression en énergie mécanique puis électrique) ; ■ le groupement auditif des éléments sonores simultanés et extraction des attributs perceptifs ; ■ la signification (interprétation en fonction des structures de connaissances abstraites) et la mise en relation (traitement des structures d'évènements) ; ■ l'élaboration d'une représentation mentale de l'environnement sonore (relation à grande échelle) ; ■ la structuration d'un cadre de référence pour l'attention et l'anticipation.

* Loi de Weber-Fechner Cette loi s'applique à l'ensemble des organes des sens et définit l'augmentation relative de la sensation comme proportionnelle au logarithme de la grandeur excitatrice. * Sensation Elle est le résultat perceptible d'une excitation. * Stimulus Pression acoustique qui met en vibration le système auditif. Le stimulus se caractérise par des grandeurs d'excitation: niveau acoustique, fréquence, durée et direction d'incidence. Quand le stimulus correspond à un son audible, il déclenche une sensation: sonie (sensation d'intensité), tonie (sensation de hauteur).

C'est un équipement électronique qui effectue une tâche bien particulière sur les signaux qui lui sont transmis. C'est le cas du microphone, du filtre et du variateur de vitesse dans le studio de musique électroacoustique traditionnel. Aujourd'hui, ce sont les pédales de transformation et tous les équipements d'effets dans les musiques amplifiées. Extérieurs donc au système de production, au système d'enregistrement ou au système de mixage, les périphériques se distinguent par rapport aux paramètres physiques qu'ils traitent. ■ l'amplitude : amplificateur, compresseur, extenseur, limiteur, noise-gate, réducteur de bruit, VCA ; ■ la fréquence : harmoniseur, oscillateur, VCO ; ■ la durée : écho, échantillonneur, flanger, phaser, retard, réverbération, spatialisateur ; ■ l'enveloppe d'amplitude : générateur et suiveur d'enveloppe ; ■ le spectre : correcteur, égaliseur, filtre, flanger, modulateur, VCF ; Certains appareils numériques programmables offrent aujourd'hui des fonctions configurables à volonté, mémorisables et interactives. La liste qui suit présente brièvement les périphériques les plus répandus. * Amplificateur (cf. -) C'est certainement le périphérique le plus connu des musiques actuelles : il sert tout simplement a augmenter l'amplitude du signal capté par le microphone. * Boîte à rythme Batterie numérique. A l'intérieur, la mémoire morte (ROM) contient le son de chaque élément d'une batterie (toms, caisse claire, cymbales, etc.). Un clavier spécial permet de programmer en temps réel ou en mode pas à pas, les séquences rythmiques, les tempos et les types de mesures. Celles-ci sont sauvegardées sur une mémoire vive (RAM). La cellule rythmique de base (pattern) qui fait une mesure, peut être recopier ou insérer dans un morceau. * Compresseur En réduisant les écarts de niveau par l'atténuation des niveaux forts et par l'amplification des niveaux faibles, le compresseur protège le système audio : il prévient d'éventuelles saturations ou distorsions. Son utilisation repose sur quatre réglages principaux : le seuil (niveau d'action en dB), le taux de compression, l'attaque (temps d'intervention) et le retour (temps de retour à la normale). La position Key permet la modification de l'attaque instrumentale ou l'atténuation de sa dynamique par une autre source. Cette fonction, couramment employée en radio, positionne automatiquement le niveau du disque par rapport à la voix. * De-esser Un de-esser est un compresseur/limiteur qui traite essentiellement les voix. Il sert à réduire l'intensité de certaines consonnes ("ss", "ch", "tz") et sifflantes lors de l'émission du son "S". Il agit sur une bande de fréquence à l'aide de 2 paramètres : un atténuateur de niveau (ou ratio) et un sélecteur de fréquences (800 Hz à 15 kHz). * Echantillonneur (Sampler) Assimilé à un enregistreur, il numérise les sons quelque soit la source (microphone, magnétophone, lecteur). Il peut mémoriser jusqu'à 6 notes d'un instrument pour répondre aux problèmes de la distorsion de timbre. On peut alors rejouer ces échantillons à partir de n'importe quel clavier MIDI. Ses principales caractéristiques sont : ■ la précision de la conversion numérique : quantification sur 8, 12, 14 ou 16 bits ; ■ la fréquence d'échantillonnage : 18 à 30 kHz ; ■ la capacité de stockage des échantillons qui limite la durée de l'enregistrement (de 1 à quelques secondes). En dehors des réglages d'entrée/sortie, l'échantillonneur dispose de commandes importantes comme l'accord de la séquence enregistrée, l'affichage et le contrôle des canaux MIDI, le filtrage, le retard, le contrôle de l'oscillateur (LFO). Les traitements sur des échantillons numériques étant les plus simple à mettre en place, on peut mettre en boucle (montage numérique), moduler l'amplitude (modification par un générateur d'enveloppe numérique ou par la vélocité d'enfoncement des touches du clavier), mixer plusieurs timbres sur la même note ou interpoler deux timbres (sur le clavier ou dans une progression dynamique). * Egaliseur (cf. - ) C'est un filtre qui agit sur le spectre du signal de sortie. * Expandeur Il regroupe dans un même boîtier plusieurs modules de synthèse, comportant des entrées et des sorties entièrement indépendantes. A chaque module correspond un canal MIDI. Le jeu et la programmation des opérateurs s'effectuent à partir d'un synthétiseur externe. L'expandeur peut être relié à une boîte à rythme, à un séquenceur ou à une console de mixage. * Extenseur En augmentant les écarts de niveau par l'amplification des niveaux forts ou moyens, et par l'atténuation des niveaux faibles, l'extenseur utilise quatre réglages principaux: le seuil (niveau d'action en dB), le taux d'extension, l'attaque (temps d'intervention) et le retour (temps d'extension). La position Key permet la modification de l'attaque instrumentale ou l'atténuation de sa dynamique par une autre source. * Filtre (cf. - ) Périphérique qui agit, supprime ou laisse passer les fréquences du signal d'entrée. * Flanger Il retarde le signal d'entrée d'une durée qui varie entre 250 µs et une dizaine de ms. La bande passante du signal d'origine est ainsi filtrée harmoniquement suivant la valeur du retard. Utile pour doubler par effet chorus une source monophonique, le flanger est intéressant sur des masses sonores synthétiques pour créer un espace aux contours fluctuants. Ses principales commandes sont : ■ le réglage de la modulation: mode manuel ou automatique de la variation du retard, commandée par un oscillateur basse fréquence (LFO) ; ■ le niveau de réinjection : si celui-ci est important, le signal devient riche en harmoniques.

* Harmoniseur Il effectue numériquement et en temps réel, les opérations de translation sur la fréquence du signal d'entrée dans un espace de une à deux octaves. La vitesse d'exécution est telle que le signal direct et le signal harmonisé semblent simultanés. L'harmoniseur est un variateur de vitesse numérique qui peut multiplier un son à volonté (transposition), rattraper la tonalité de deux instruments ou créer des effets spéciaux (arpège automatique, son inversé). L'emploi d'un clavier MIDI permet le réglage automatique de la hauteur. Ses principales commandes sont : ■ le niveau d'entrée du signal d'origine ; ■ le réglage de la hauteur à laquelle le son d'origine doit être harmonisé ; ■ la réinjection-arpéggiateur qui boucle une partie du retard de l'harmoniseur sur lui-même ; ■ le vibrato : oscillation de la hauteur du son harmonisé.

* Limiteur Dispositif utilisé essentiellement pour éviter la surcharge accidentelle des dispositifs électroniques en avals, le limiteur est souvent couplé avec le compresseur. C'est un système "faussement linéaire": la forme d'onde reste intacte contrairement à un écrêteur. * Noise-Gate Il fonctionne sur le principe voisin du compresseur et peut servir de réducteur de bruit: l'atténuateur automatique se transforme alors en un coupe-voie électronique. Les appareils les plus simples comportent trois commandes : ■ le seuil de déclenchement ; ■ le temps d'attaque (entre 0,3 et 20 ms) ; ■ le temps de retour (entre 0,02 et 2,5 ms). En position Key, le noise-gate doit être activé par un signal externe. * Octaveur Dispositif qui multiplie ou divise par 2, la fréquence du signal d'entrée. * Réducteur de bruit (cf. -) Comme son nom l'indique, il réduit les bruits parasites sur le signal d'entrée. * Retard (Delay) Il retarde le signal d'entrée de 1 à 300 ms. Son application donne de la présence à un signal monophonique ponctuel et peut créer une pseudo-stéréophonie, un doublage des sources ou un phénomène d'écho. Tout retard comprend plusieurs commandes : ■ le réglage du niveau d'entrée: taux de modulation ; ■ l'édition du temps du retard: inférieur à 10 ms, le retard est un déphaseur; supérieur à 50 ms, il devient écho ; ■ la réinjection: sur des temps inférieurs à 20 ms, on obtient une résonance caractéristique (enrichissement des hautes fréquences par multiplication des harmoniques) ; ■ le filtrage du retour en fonction du retard programmé ; ■ la relecture indéfinie du son qui passe dans le retard ; ■ la variation plus ou moins rapide de la hauteur tonale du signal retardé par l'oscillateur basse fréquence: effets de doublage (chorus) et de flanging.

* Réverbération Programmable, elle contient en mémoire un certain nombre de configurations de salle. Le retard initial de l'onde directe est réglable et rend crédible la réverbération en la détachant de quelques centièmes de seconde. On peut aussi fixer la progression des amplitudes et des retards successifs. * Séquenceur (Sequencer) Enregistreur multipiste particulier, le séquenceur mémorise des données numériques (codes MIDI, pas de programmation, notes, ordre de contrôle, sélection des sons) pour activer d'autres périphériques. Il se caractérise par le nombre de ses voies reliées à une unité de synthèse, et par sa mémoire (notes réparties entre les voies). La programmation s'effectue en temps réel ou en mode pas à pas. Toutes les opérations (copie, insertion, mixage, montage, reprise) sont simples à effectuer. * Spatialisateur Il reçoit les signaux sonores des sources instrumentales ou de synthèse et leur ajoute en temps réel, des effets de spatialisation (localisation, effets de salle) diffusés sur un système électroacoustique (casque ou ensemble de haut-parleurs). Sur les nouveaux amplificateurs audiovidéo, le système Pro Logic Dolby Surround peut centrer les dialogues au milieu de l'écran alors que les bruits ou la musique ambiante sont répartis. Il offre en outre un programme d'effets qui simule l'acoustique des salles (église, salle de concert). * Variateur de vitesse Dispositif qui modifie la vitesse du défilement de la bande magnétique. Aujourd'hui l'harmoniseur réalise numériquement et en temps réel ces variations.

L'actuelle théorie linguistique recense 41 échantillons sonores, appelés phonèmes : ceux-ci recouvrent tous les sons utilisés dans la langue anglaise courante. Les linguistes divisent ces phonèmes en catégorie : les voyelles (17), les consonnes (7), les fricatives (9), les plosives (6) et les affriquées (2). On remarquera que le nombre de phonèmes voyelles et consonnes ne correspond pas avec l'alphabet écrit dans lequel a, e, i, o, u et quelquefois y et w sont des voyelles, et tous les autres sons sont des consonnes. Phonétiquement, il y a beaucoup plus de sons voyelles comme i dans bit ou i dans bite, par exemple. Tous les autres phonèmes sont classés suivant la manière dont ils sont produits : m, s, p et j sont classés respectivement comme consonne, fricative, plosive et affriquée. En pratique, les systèmes de synthèse de la parole font appel à des ensembles de phonèmes : les diphones (recouvrement d'un phonème sur le début d'un autre), les triphones (diphone avec un phonème au milieu), et les allophones (variations d'un phonème).

Pression acoustique (SPL : Sound Pressure Level) Elle décrit les variations de pression d'un point dans un champ acoustique. Elle s'exprime et se mesure avec la même unité que la pression de l'air: le Pascal (Newton/m2). Pascal "Une pression exercée sur un fluide, l'air par exemple, se transmet intégralement en tous sens et en tous point de ce fluide". La pression acoustique de référence P0(ou seuil d'audibilité) est égale à 2 x 10-5 Pa et le seuil de douleur est de 102 Pa. Pour une onde de pression efficace P, le niveau de pression Lpest tel que Lp = 20 log (P/P0). Lorsqu'on parle d'un son à 60 dB, on signifie qu'il a 60 dB de pression acoustique. Si on multiplie la pression acoustique par n, l'augmentation du niveau acoustique est égale à 20 Log(n) dB. ATTENTION : Le niveau de pression et le niveau de puissance (voir puissance acoustique), exprimés en décibels sont des grandeurs physiques fondamentalement différentes: le niveau de pression est caractéristique de la source et de la propagation depuis cette source alors que le niveau de puissance caractérise uniquement la source.

Grâce aux nombreuses techniques de synthèse, aux gigantesques bandothèques des radiotélévisions et aux catalogues sur CD-ROM, disposer de sons aujourd'hui n'est plus aussi difficile qu'au début de la musique concrète. Néanmoins la prise de son garde toute son actualité pour "micrographier" les signaux en recherche ou au cinéma, ou pour diffuser et enregistrer les oeuvres instrumentales (G. Kisselhoff : "La prise de son stéréophonique", 1993). En 1954, A. Charlin mettait au point une tête artificielle pour la prise de son stéréophonique binaurale. Deux images complémentaires d'une même source sonore sont ainsi recueillie, proches de l'information préférentielle que chacun reçoit de ses oreilles. Le champ de pression acoustique enregistré est alors comparable à celui qui stimule l'auditeur dans la salle de concert. Tous les couples de prise de sons stéréophoniques ("AB", "MS", "Stéréosonic", "XY") sont régis par le corrélateur de phase. * Couple "AB" Dispositif avec deux microphones cardioïdes placés de telle façon que les paramètres géométriques principaux soient l'écartement du centre des capsules microphoniques, l'angle de leurs axes, l'orientation et l'éloignement par rapport à la source. Dans ce couple, on joue sur la distance entre les micros et l'angle de leurs axes pour modifier la précision et la largeur de la scène sonore. Le meilleur compromis est obtenu par une distance de 17 cm et un angle de 110°. * Couple "MS" Dispositif comportant un microphone cardioïde, dirigé vers la source sonore et un microphone bidirectionnel dont l'axe est perpendiculaire au précédent. Le couple "MS" donne une image quelque peu heurtée. * Couple "Stéréosonic" Dispositif comportant deux microphones bidirectionnels, à gradient de pression. Ils sont placés tels que leurs axes soient perpendiculaires et que la source sonore soit dans le plan de symétrie de l'ensemble. * Couple "XY" Dispositif comportant deux microphones coïncidents, dont les axes sont orientés à 90°, et dont le diagramme est cardioïde. Le couple "XY" donne une scène sonore douce, aux contours assez peu précis, sinon flou.

Les signaux sonores ne peuvent se transmettre à distance que s'il existe un milieu élastique, capable de reprendre son état initial naturel après avoir subi des déformations relatives à une contrainte temporaire. L'air est à la fois un très bon ressort et une masse faible, mais non négligeable. La vitesse de déplacement des molécules autour de leur position d'équilibre est petite. Néanmoins, étudiée théoriquement dans une atmosphère calme et homogène, la propagation est perturbée par les turbulences. Igor Stravinsky, "Poétique musical" (1952) "Le son, tout comme la lumière, a des actions différentes selon la distance qui sépare le lieu d'où on l'émet, du point où on le reçoit". Dans l'air, la façon dont les signaux sonores se propagent peut être décrite par une relation entre le déplacement des particules, le temps et la distance à la source. Dans une salle, ils se déplacent par réflexions multiples comme des rayons lumineux, selon la géométrie de la salle, les propriétés des parois, la position de la source et la place des auditeurs. Igor Stravinsky, "Poétique musical" (1952) "A augmenter le nombre des points d'émission, on augmente les distances qui les séparent les uns des autres et de l'auditeur. En sorte que plus on multiplie ces points d'émission, plus la réception sera confuse". L'introduction dans le champ acoustique d'un corps diffractant ne modifie pas la fréquence si l'émetteur et le récepteur sont en repos relatif. Par conséquent, on ne peut pas prévoir exactement la forme des ondes sonores lorsqu'on place un obstacle dans le champ, et encore moins s'il s'agit de la tête. Lorsqu'on s'éloigne d'une source sonore, les fréquences aiguës chutent beaucoup plus vite que les fréquences graves. Elles possèdent moins d'énergie et ébranlent l'air dans un cercle plus restreint. La diminution du niveau, due à l'atténuation géométrique est de 6 dB quand on double la distance à la source. La composition de l'air, la pression atmosphérique et la température jouent un grand rôle dans les phénomènes d'absorption. L'énergie acoustique émise par la source arrive aux oreilles avec une différence de temps de propagation. Celle-ci, directement liée à la direction azimutale de la source, n'altère pas l'image auditive et précise la localisation. L'effet d'antériorité des ondes directes permet, jusqu'à un certain point de faire abstraction des ondes réverbérées. En 1922, E. Varèse décrit dans Hyperprism, un univers en relief qui concrétise sur le plan perceptif l'importance des réflexions entre les sources instrumentales. Edgar Varèse (O. Vivier, 1973) "Dans mon oeuvre, on trouve à la place de l'ancien contrepoint linéaire fixe, le mouvement de plans et de masses sonores, variant en intensité et en densité. Quand ces sons entrent en collision, il en résulte des phénomènes de pénétration ou de répulsion. Certaines transmutations prennent place sur un plan. En les projetant sur d'autres, on crée une impression auditive de déformation prismatique". * Absorption Lorsqu'un signal sonore rencontre un obstacle, une partie de son énergie incidente est absorbée. Cette absorption correspond à une transformation en chaleur par la mise en vibration des molécules du corps solide constituant l'obstacle. Les matériaux possèdent tous un coefficient d'absorption qui joue un rôle important en acoustique des salles. Les matériaux absorbants se répartissent en matériaux poreux (laine de verre, ouate, moquette) et résonateurs. Avec des parois absorbantes, on observe toujours un maximum de pression au voisinage de la surface du mur: c'est à cet endroit que la vitesse des particules d'air est à son minimum. L'absorption due à l'air des fréquences aiguës n'est pas négligeable dans les salles de grand volume. * Diffraction Lorsqu'un signal sonore traverse un obstacle par un trou, son énergie incidente rayonne de l'autre côté, dans tous les sens comme une nouvelle source. On dit que le signal est diffracté. Pour un auditeur, les intensités reçues à l'entrée des conduits auditifs gauche et droit dépendent du coefficient de diffraction de la tête. Si l'on se limite à des signaux sinusoïdaux, la diffraction intervient très peu aux fréquences graves (inférieures à 1000 Hz), quand la longueur d'onde devient nettement supérieure aux dimensions de la tête. * Diffusion Lorsqu'un signal sonore se réfléchit dans des directions variées, il y a diffusion de l'énergie. * Focalisation Lorsque le foyer d'un signal sonore se concentre à la réception en un deuxième foyer, il y a focalisation. C'est le cas observé dans le métro où l'on perçoit distinctement la parole d'un locuteur placé sur le quai d'en face. * Impédance acoustique Rapport de la pression acoustique (en Pascal) à la vitesse vibratoire (mètres par seconde) sur une durée supérieure à la période d'oscillation. L'impédance acoustique caractérise le milieu de propagation en un point. * Réflexion Lorsqu'un signal sonore rencontre un obstacle dont les dimensions sont très grandes par rapport à sa longueur d'onde, une partie de l'énergie incidente de ce signal est réfléchie comme un rayon lumineux: l'angle d'incidence est égal à l'angle de réflexion. De même fréquence que l'onde incidente, l'onde réfléchie a une amplitude inférieure ou égale, et une phase différente. Le facteur de réflexion est une caractéristique de l'obstacle. * Réfraction Lorsqu'un signal sonore traverse un obstacle, une partie de son énergie incidente est partiellement réfléchie, diffusée, et diffractée de l'autre côté. On dit que le signal est réfracté car sa direction a été modifiée. * Turbulence Quand l'air est mis en mouvement par une action extérieure, un certain nombre de modes sont excités. Sans excitation, nous avons un état stationnaire. Avec un mode, nous observons des oscillations périodiques. Avec plusieurs modes, le mouvement de l'air devient irrégulier, puis turbulent (L.-D. Landau: Sur le problème de la turbulence, 1944). On ne peut pas modéliser les turbulences en superposant plusieurs modes mais en employant des attracteurs étranges qui sont des fractales ou objets de dimensions non entières (J. Mandelbrot: Les objets fractales, 1975).

La psycho-acoustique fait intervenir les perceptions, les représentations mentales et les motivations psychologiques de l'auditeur en liaison étroite avec l'acoustique physique et physiologique. Elle analyse et formalise les relations qui existent entre le stimulus acoustique et la sensation auditive.

Exprimée en Watts, la puissance acoustique est l'énergie totale d'une source sonore, capable d'émettre dans toutes les directions: une puissance acoustique de 1 W, rayonnée de manière omnidirectionnelle en espace libre, correspond à un niveau de 109 dB à 1 mètre. La puissance W d'une onde de pression a un niveau sonore Lw tel que Lp = 10 log (W/W0) : W0 est égale à 10-12 Watts. ATTENTION : Le niveau de pression (cf. intensité acoustique) et le niveau de puissance, exprimés en décibels sont des grandeurs physiques fondamentalement différentes: le niveau de pression est caractéristique de la source et de la propagation depuis cette source alors que le niveau de puissance caractérise uniquement la source. Le rock contemporain pratique une extraordinaire escalade : 5000 W pour les Rolling Stones en 1965, 8000 pour Pink Floyd en 1970, 30000 pour AC DC en 1979 et 50000 pour les concerts géants es années 80. On est loin du petit ampli de 50 W des années 1950.

|